Navegação Moderna e Segurança: A Polêmica em Torno do DeepSeek

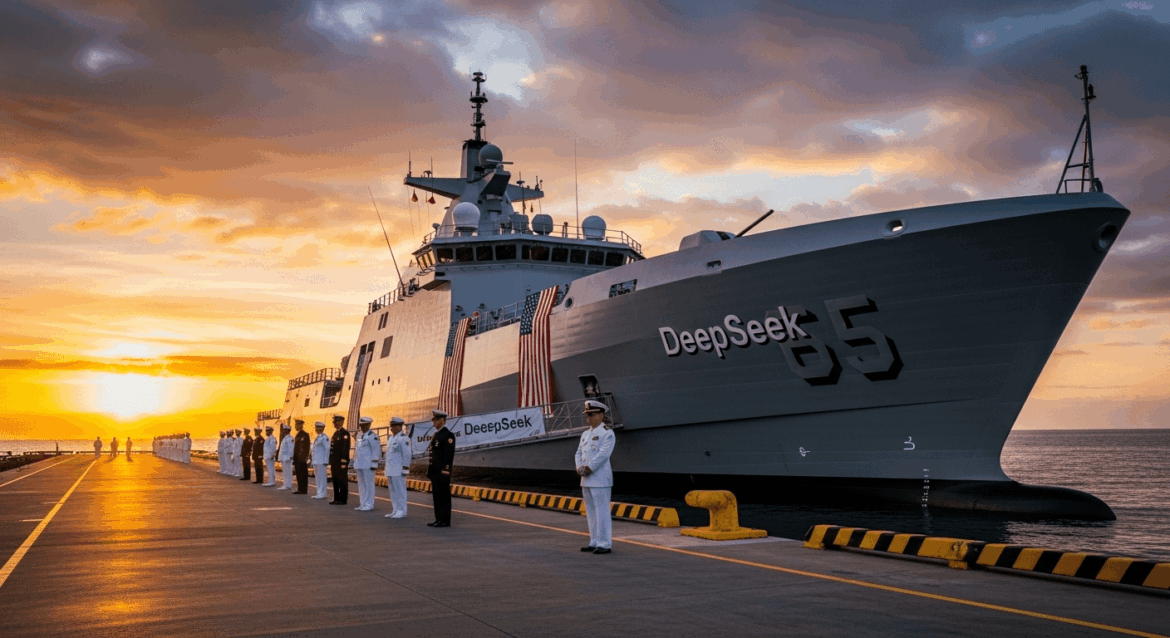

Nos últimos anos, a utilização de inteligência artificial (IA) se expandiu de forma acelerada, gerando tanto entusiasmo quanto preocupações, especialmente entre instituições como a Marinha dos Estados Unidos. Recentemente, a Marinha emitiu um alerta aos seus membros sobre o uso de um chatbot desenvolvido por uma startup chinesa chamada DeepSeek. Esse aviso ressalta a crescente tensão entre inovação tecnológica e segurança cibernética.

A decisão da Marinha foi fundamentada em “preocupações de segurança e éticas associadas à origem e ao uso do modelo”. Essa ressalva evidencia a necessidade de se considerar não apenas a funcionalidade de ferramentas como chatbots, mas também o impacto de sua origem e as implicações que podem surgir de seu uso.

O Crescimento e os Riscos dos Chatbots de IA

O fenômeno dos chatbots de IA, como o da DeepSeek, levantou questões críticas sobre segurança e privacidade. Apesar de sua popularidade e potencial inovação, o surgimento de “ataques maliciosos” levou a startup a limitar o número de novos usuários. Essa medida é indicativa das vulnerabilidades que essas tecnologias podem apresentar, não apenas para os indivíduos, mas também para organizações e países.

Chatbots podem armazenar e processar grandes volumes de dados. Quando não projetados com rigorosos protocolos de segurança, esses sistemas podem ser alvo de hackers, que buscam explorar falhas para obter informações sensíveis. É nesse contexto que a prudência da Marinha se torna mais evidente. A preocupação em relação ao uso de tecnologias desenvolvidas fora do controle governamental, especialmente de regiões consideradas desafiadoras em termos de segurança, não pode ser subestimada.

O Caso DeepSeek: Mais do Que Apenas Segurança?

Além da segurança, questões éticas também emergem com o uso de tecnologias provenientes de startups com pouca transparência. O caso do DeepSeek ilustra como a falta de regulamentação pode levar a preocupações sobre a manipulação de dados e o uso indevido de sistemas de IA. A interseção entre tecnologia e moralidade se torna um debate acalorado à medida que as organizações ponderam os benefícios versus os riscos associados.

- Vulnerabilidades Cibernéticas: Ferramentas de IA, se mal utilizadas, podem resultar em vazamentos de dados.

- Ética na IA: A questão da responsabilidade no uso de tecnologias deve ser considerada.

- Transparência: Startups devem fornecer informações claras sobre os dados utilizados e a metodologia de treino de suas IAs.

Os profissionais da segurança estão cada vez mais em alerta quanto às implicações do uso indevido da IA, considerando não apenas as fraudes e roubos de dados, mas também o potencial para manipulações a nível governamental e a espionagem corporativa.

Impacto da Decisão da Marinha e Reações do Mercado

A decisão da Marinha dos EUA em emitir um alerta pode ter consequências significativas, não apenas para a DeepSeek, mas para toda a indústria de tecnologia emergente. Essa postura pode criar precedentes que influenciam o desenvolvimento e a regulamentação de tecnologias de IA no futuro. As empresas que operam nesse espaço devem considerar as implicações de segurança ao desenvolver suas soluções, equilibrando inovação e responsabilidade.

A indústria de tecnologia também responde a esses desafios. Empresas estão sendo incentivadas a implementar protocolos de segurança rígidos e transparentes, além de manter um diálogo aberto sobre os riscos associados ao uso de IA. Essa abordagem não apenas protege os usuários, mas também fortalece a confiança do público no uso de tecnologias emergentes.

Exemplos de Preocupações em Segurança com AI

Casos em que sistemas de IA falharam ou foram manipulados ilustra a necessidade de um escrutínio rigoroso. Alguns incidentes conhecidos incluem:

- Algoritmos de reconhecimento facial que resultaram em discriminação.

- Assistentes virtuais que foram hackeados para espionagem.

- Robôs de chat que disseminaram informações falsas.

Esses exemplos mostram que a evolução da tecnologia deve ser acompanhada de uma reformulação nas diretrizes que governam sua utilização, priorizando sempre a segurança e a ética.

O Futuro da Tecnologia de IA e a Necessidade de Regulamentação

No cenário atual, a necessidade de regulamentação no campo da inteligência artificial se torna cada vez mais urgente. À medida que empresas inovam e desenvolvem soluções que podem impactar significativamente a sociedade, é crucial que existam diretrizes claras que orientem o uso responsável dessas tecnologias.

A experiência da DeepSeek é um exemplo didático de como a falta de regulamentação pode levar a reações adversas por parte de instituições conservadoras, como a Marinha dos EUA. Assim, o futuro da IA pode depender de uma abordagem colaborativa entre desenvolvimento tecnológico e regulamentação aplicada.

A responsabilidade social deve ser colocada em primeiro lugar, e as inovações devem ser balanceadas pelo compromisso com a segurança e a ética. Essa será uma das grandes missões dos próximos anos, à medida que a tecnologia continua a avançar.

Questões em Aberto Sobre Segurança em Tecnologias de IA

Com a crescente integração da IA em diversas esferas, surge a necessidade de discutir algumas questões em aberto:

- Como garantir que as ferramentas de IA sejam usadas de forma ética?

- Quais medidas de segurança devem ser implementadas para proteger dados sensíveis?

- Há espaço para regulamentação sem sufocar a inovação?

As respostas a essas perguntas formarão a base do desenvolvimento responsável e ético da tecnologia, essencial para o progresso contínuo da sociedade.